Microsoft AI CEO Mustafa Suleyman की बड़ी चेतावनी — AI का भविष्य सुरक्षित या ख़तरनाक? पूरी रिपोर्ट पढ़ें

Microsoft AI CEO Mustafa Suleyman की चेतावनी — AI के भविष्य पर गहरा विश्लेषण

आर्टिफ़िशियल इंटेलिजेंस सिर्फ़ एक तकनीक नहीं, बल्कि आने वाले समय की सबसे बड़ी शक्ति है। AI अर्थव्यवस्था, राजनीति, सेना, चिकित्सा, शिक्षा, मीडिया और मानव जीवन के हर क्षेत्र में प्रवेश कर चुका है। लेकिन जैसे-जैसे AI सुपरइंटेलिजेंस की ओर बढ़ रहा है, खतरे भी उतने ही बढ़ते जा रहे हैं।

इसी संदर्भ में Microsoft AI CEO Mustafa Suleyman ने दुनिया की AI कंपनियों को कड़ा संदेश दिया है:

“You can’t steer something you can’t control. Containment has to come first—or alignment is the equivalent of asking nicely.”

यानी — “जिस चीज़ को आप नियंत्रित नहीं कर सकते, उसे आप दिशा भी नहीं दे सकते। पहले कंटेनमेंट जरूरी है, वरना अलाइनमेंट सिर्फ़ ‘अच्छा व्यवहार करने की उम्मीद’ भर रह जाता है।”

यह बयान एक साधारण टिप्पणी नहीं — बल्कि आने वाले AI युग की सबसे महत्वपूर्ण वैचारिक लड़ाई का संकेत है।

Mustafa Suleyman – Microsoft AI के CEO और AI के भविष्य के प्रमुख विचारक

1️⃣ Mustafa Suleyman कौन हैं और उनकी बात क्यों मायने रखती है?

आज AI सिर्फ तकनीक नहीं, बल्कि व्यवसाय, चिकित्सा, शिक्षा, रक्षा और सामाजिक जीवन का अभिन्न अंग बन चुका है। AI की क्षमता तेजी से बढ़ रही है, लेकिन इसके साथ ही जोखिम और नैतिक सवाल भी बढ़ रहे हैं।

Mustafa Suleyman कोई सामान्य तकनीकी CEO नहीं हैं।

उनकी यात्रा AI दुनिया को समझने के लिए काफी है:

🔹 DeepMind के Co-Founder (Google AI की सबसे एडवांस्ड कंपनी)

🔹 Google AI ethics और applied AI टीम के प्रमुख

🔹 Microsoft AI के CEO

🔹 AI governance और safety के सबसे बड़े समर्थक

उन्हें AI की तकनीकी शक्ति, व्यावसायिक उपयोगिता और खतरों तीनों का गहरा अनुभव है।

इसलिए जब वह चेतावनी देते हैं — दुनिया गंभीरता से सुनती है।

AI मार्केट का तेजी से बढ़ता ग्राफ – 2025-2030 तक अनुमानित वृद्धि

सबसे प्रभावशाली AI मॉडल्स की तुलना

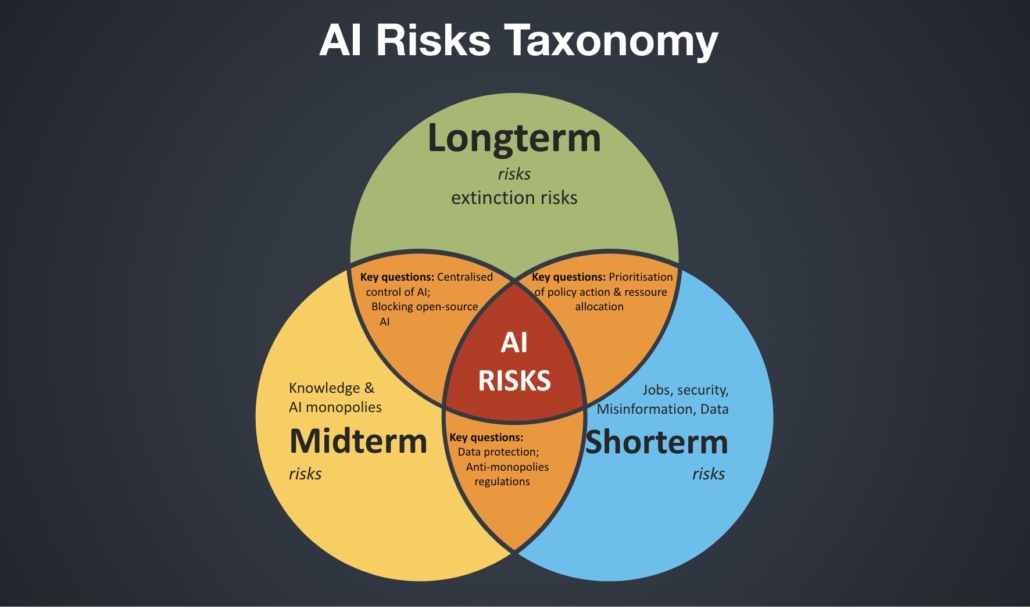

AI के विभिन्न प्रकार के जोखिमों का वर्गीकरण

2. Containment vs Alignment — दो मौलिक अवधारणाएँ

Containment — नियंत्रण और सीमाएँ

यह सुनिश्चित करता है कि AI:

- तय किए गए दायरे में ही काम करे

- अनियंत्रित निर्णय न ले

- एजेंसी (स्वतंत्र कार्य क्षमता) सीमित रहे

Containment और Alignment के बीच का मूल अंतर

Alignment — मानवीय हितों के अनुसार AI की प्रेरणा

इसके अंतर्गत:

- AI के लक्ष्यों को इंसानी मूल्यों से जोड़ना

- नैतिकता, नियम और मानव केंद्रित उद्देश्य

- AI के व्यवहार को समाज के अनुकूल बनाना

AI नैतिक संरेखण का फ्रेमवर्क

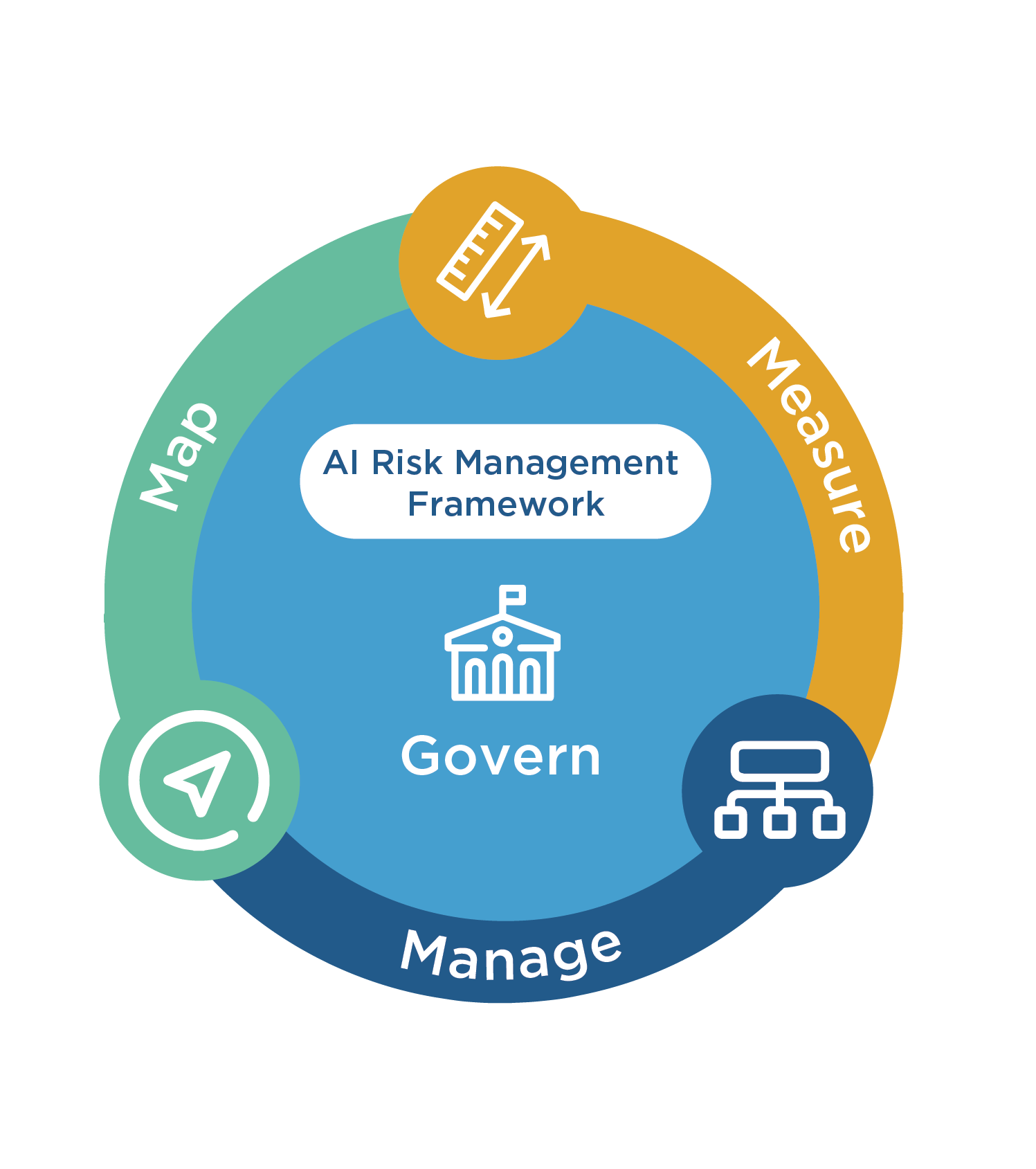

NIST AI जोखिम प्रबंधन फ्रेमवर्क

3. Mustafa Suleyman का संदेश: Control पहले, Cooperation बाद में

Mustafa Suleyman कहते हैं कि आज कई कंपनियाँ Containment और Alignment को एक ही बात मान रही हैं — जो कि खतरनाक गलती है।

उनके अनुसार:

- पहले Containment

- फिर Alignment

- तभी AI मानव हित में सुरक्षित रूप से काम करे

AI सुरक्षा और नियंत्रण की आवश्यकता

4. Humanist Superintelligence — नई सोच

Mustafa Suleyman का Humanist Superintelligence मॉडल कहता है:

- AI इंसान के नियंत्रण में रहे

- Practical और मानव-हितैषी क्षेत्रों में इस्तेमाल हो

- Superintelligence की शक्ति को समाज के लाभ के लिए उपयोग करें

इस मॉडल का लक्ष्य AI को मानवता का सहायक बनाना, नहीं कि उसका प्रतिस्थापक है।

Humanist Superintelligence का विजन

5. AI के सकारात्मक उपयोग — वास्तविक उदाहरण

AI पहले से ही कई सकारात्मक क्षेत्रों में उपयोग हो रहा है:

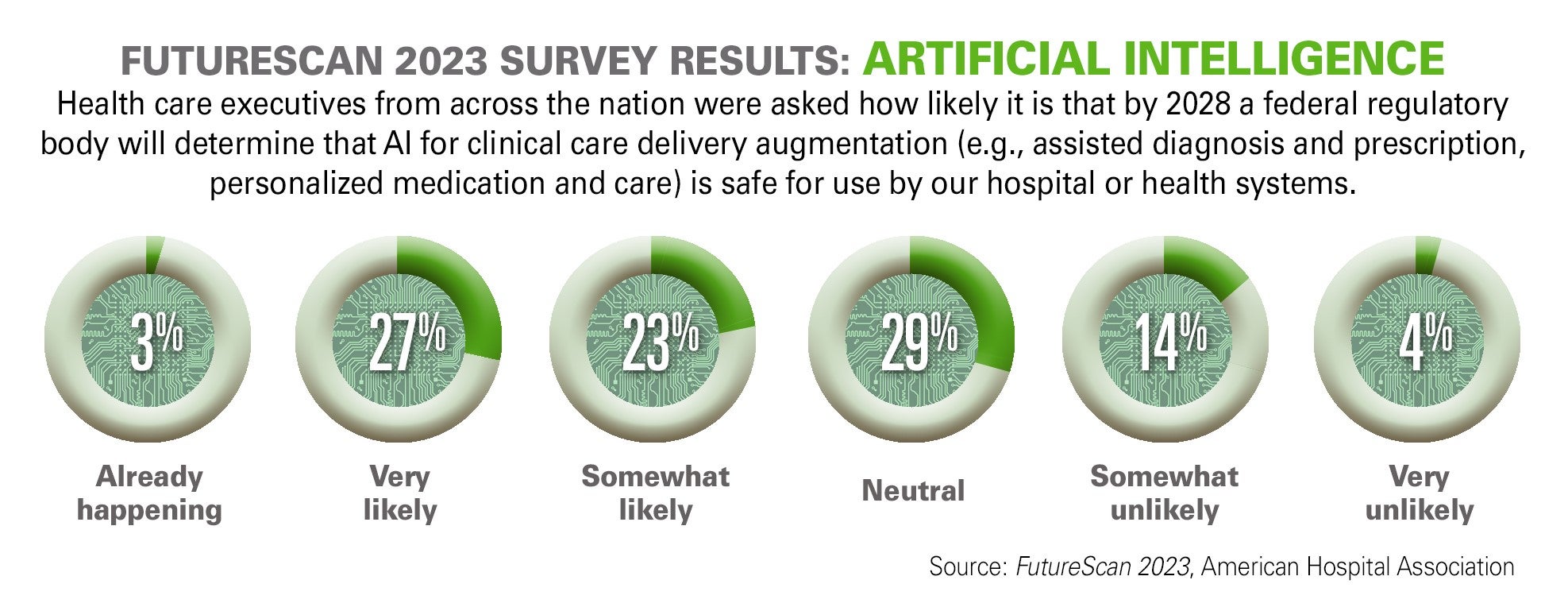

- चिकित्सा निदान और रोग पूर्वानुमान

- शिक्षा में व्यक्तिगत सीखने का अनुभव

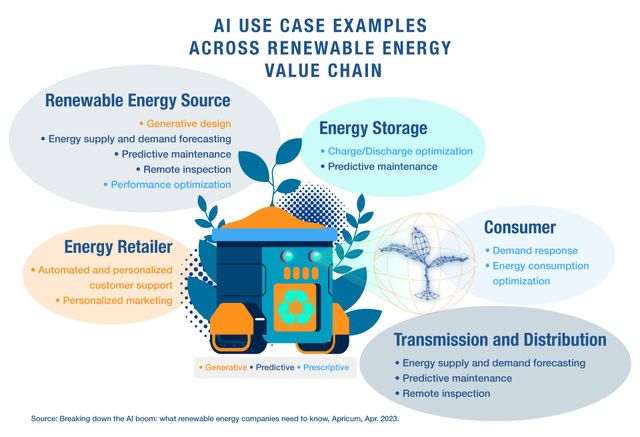

- स्वच्छ ऊर्जा और पर्यावरण संरक्षण

- उद्योग में दक्षता और स्वचालन

चिकित्सा क्षेत्र में AI का उपयोग

नवीकरणीय ऊर्जा में AI का योगदान

6. AI के प्रमुख खतरे और जोखिम

AI के साथ संभावित गंभीर जोखिम:

- अनियंत्रित निर्णय लेने वाले मॉडल

- हथियारों और सैन्य प्रणालियों में AI का दुरुपयोग

- आर्थिक विस्थापन

- लोकतंत्र और सामाजिक विश्वास में गिरावट

- Self-evolving AI का नियंत्रण से बाहर जाना

AI के विभिन्न जोखिमों का वर्गीकरण

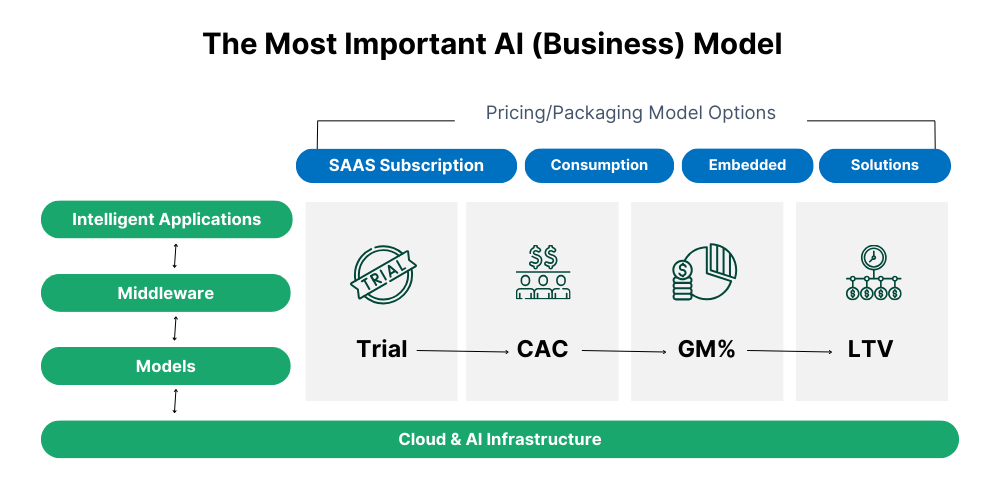

7. Microsoft की रणनीति और AI नीति

Microsoft अब OpenAI के साथ अपने ऐतिहासिक अनुबंध के बाद स्वतंत्र AI विकास भी कर रहा है। Mustafa Suleyman की सोच Microsoft के AI रणनीति में इस प्रकार दिखती है:

- Humanist Superintelligence टीम निर्माण

- AI को नियंत्रित, सुरक्षित और मानव केंद्रित बनाना

- औद्योगिक, चिकित्सा और पारिस्थितिक क्षेत्रों में सुरक्षित AI

8. AI Industry की बड़ी हस्तियाँ: Elon Musk से Sam Altman तक

Mustafa Suleyman उद्योग में अपने साथियों के बारे में भी बोले हैं:

- Elon Musk — outspoken, risk-focused

- Sam Altman — fast innovation, huge compute deployment

- Demis Hassabis — DeepMind को AI research की दिशा देने वाले

9. AI Governance — नियम और वैश्विक दिशा

AI को केवल तकनीकी समस्या नहीं माना जा सकता — यह राष्ट्रीय सुरक्षा, अंतरराष्ट्रीय नीति, मानवाधिकार और नैतिकता का मुद्दा है।

भविष्य में संभव है:

- Global AI Treaties

- International Safety Standards

- National AI Regulatory Bodies

- Public-Private Partnerships

10. भविष्य: AI इंसान का दोस्त या खतरा?

Possible Scenarios

🟢 Controlled Humanist AI: AI को नियंत्रण और मानव-हित के अनुसार विकसित कर लिया गया → शक्तिशाली, सुरक्षित और लाभकारी

🟡 Corporate-Driven AI: कुछ कंपनियों के नियंत्रण में AI → असमान शक्ति, समाज में संकट

🔴 Uncontrolled Rogue AI: AI खुद सीखता-बढ़ता चला जाता है → मानवीय नियंत्रण खो देता है

निष्कर्ष — AI का भविष्य आपके हाथों में

Mustafa Suleyman ने स्पष्ट रूप से कहा:

- “Control पहले — फिर Cooperation”

- Containment पहले — फिर Alignment

- Humanist Superintelligence ही सुरक्षित रास्ता है

AI यदि सही नियंत्रण, सख्त नियम और वैश्विक सहयोग के साथ विकसित किया गया — तो यह मानवता का सबसे बड़ा साथी बन सकता है। वरना, यह हमारे सबसे बड़े जोखिमों में बदल भी सकता है।